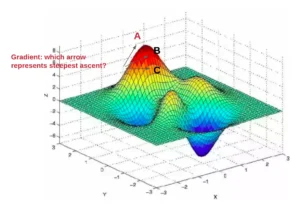

Trong giải tích đa biến, vector gradient (ký hiệu là \( \nabla f \)) thường được giới thiệu một cách cơ học như “vector các đạo hàm riêng”. Với nhiều sinh viên, định nghĩa này chỉ dừng lại ở công thức, trong khi một ý nghĩa hình học cực kỳ quan trọng lại bị bỏ qua:

Gradient chỉ hướng tăng nhanh nhất (steepest ascent) của hàm số.

Bài viết này sẽ trả lời một cách chuẩn mực nhưng trực quan: vì sao điều đó đúng về mặt toán học? Qua đó, bạn sẽ thấy rõ mối liên hệ giữa gradient và các thuật toán AI như Gradient Descent.

1. Gradient là gì?

Xét một hàm số hai biến f(x, y). Gradient của f tại một điểm được định nghĩa là vector gồm các đạo hàm riêng:

\[

\nabla f(x,y) =

\left[

\frac{\partial f}{\partial x}

\quad

\frac{\partial f}{\partial y}

\right]

\]

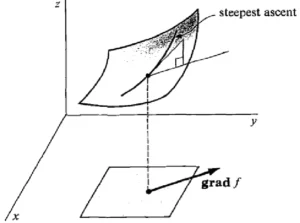

Về mặt đại số, gradient đơn giản là một vector. Nhưng về mặt hình học, nó có một ý nghĩa rất mạnh:

Nếu bạn coi đồ thị của f như một bề mặt địa hình, thì gradient tại một điểm sẽ chỉ cho bạn hướng cần đi để leo lên nhanh nhất tại điểm đó.

Để hiểu và chứng minh phát biểu này, chúng ta cần một khái niệm trung gian: đạo hàm theo hướng.

2. Đạo hàm theo hướng và tích vô hướng

Giả sử bạn đang đứng tại một điểm trên bề mặt \( f(x,y) \) và muốn di chuyển theo một hướng bất kỳ.

Hướng đó được biểu diễn bởi một vector đơn vị \( \vec{v} \) (tức là \( |\vec{v}| = 1 \)).

Câu hỏi đặt ra là:

Nếu ta đi theo hướng \( \vec{v} \), thì giá trị của hàm số thay đổi nhanh đến mức nào?

Câu trả lời chính là đạo hàm theo hướng của \( f \) theo \( \vec{v} \), ký hiệu là \( D_{\vec{v}} f \). Trong giải tích đa biến, kết quả quan trọng là:

\[

D_{\vec{v}} f = \nabla f \cdot \vec{v}

\]

Nghĩa là: tốc độ thay đổi của hàm theo một hướng bất kỳ chính là tích vô hướng giữa gradient và hướng đó.

Tại đây, bài toán hình học bắt đầu xuất hiện.

3. Lời giải hình học từ tích vô hướng

Theo định nghĩa hình học, tích vô hướng của hai vector được viết dưới dạng:

\[

\nabla f \cdot \vec{v}

=

|\nabla f| \, |\vec{v}| \cos(\theta)

\]

trong đó \( \theta \) là góc giữa hai vector \( \nabla f \) và \( \vec{v} \).

Vì \( \vec{v} \) là vector đơn vị (\( |\vec{v}| = 1 \)), nên biểu thức đạo hàm theo hướng trở thành:

\[

D_{\vec{v}} f = |\nabla f| \cos(\theta)

\]

Biểu thức này cho ta một cách nhìn cực kỳ rõ ràng:

- \( |\nabla f| \) là một hằng số tại điểm đang xét.

- Giá trị của đạo hàm theo hướng chỉ phụ thuộc vào \( \cos(\theta) \).

Để hàm số tăng nhanh nhất, ta cần làm cho \( D_{\vec{v}} f \) đạt giá trị lớn nhất. Điều này xảy ra khi:

\[

\cos(\theta) = 1

\quad \text{hay tương đương với} \quad

\theta = 0^\circ

\]

Nói cách khác, hướng \( \vec{v} \) phải trùng hoàn toàn với hướng của vector gradient.

Đây chính là lý do toán học cốt lõi cho phát biểu:

Gradient chỉ hướng tăng nhanh nhất của hàm số.

4. Kết luận và ý nghĩa trong AI

Từ lập luận trên, ta rút ra hai kết luận quan trọng:

- Hướng của gradient (\( \nabla f \)): là hướng mà hàm số tăng nhanh nhất tại điểm đó.

- Độ lớn của gradient (\( |\nabla f| \)): chính là tốc độ tăng lớn nhất có thể đạt được theo bất kỳ hướng nào.

Hiểu được điều này không chỉ giúp bạn nắm vững giải tích đa biến, mà còn là nền tảng để hiểu các thuật toán trong AI và Machine Learning:

- Gradient Descent: đi ngược hướng gradient để giảm hàm loss nhanh nhất.

- Gradient Ascent: đi theo hướng gradient để tối đa hóa một hàm mục tiêu.

Gradient không chỉ là một công thức – nó là cầu nối giữa hình học, giải tích và các thuật toán học máy hiện đại.

Link tham khảo: Why the gradient is the direction of steepest ascent – YouTube